AI a przestępczość – przewidywanie i odpowiedzialność karna

Algorytm komputerowy opracowany przez socjologów z Uniwersytetu Chicagowskiego prognozuje przestępczość w dużym mieście z 90-procentową dokładnością. Badacze wykorzystali dane historyczne dotyczące przestępstw z użyciem przemocy i przestępstw przeciwko mieniu w Chicago, a następnie podzielili miasto na kwadraty o powierzchni prawie 93 m2 każdy. Zastosowana przez nich metoda sprawdziła się również w Los Angeles, Filadelfii i Atlancie.

Przepisy prawa nie regulują kwestii odpowiedzialności sztucznej inteligencji za popełnione przestępstwo. Dlatego użytkownicy końcowi AI – np. kierowcy czy lekarze – mogą unikać korzystania z niej, jeśli odpowiedzialność za potencjalnie śmiertelne błędy poniosą wyłącznie oni. Wkrótce sąd w Kalifornii ma wydać wyrok w sprawie wypadku, w którym zginęły dwie osoby, a oskarżony jechał samochodem marki Tesla, wyposażonym w system jazdy AI. Amerykański Urząd ds. Bezpieczeństwa Ruchu Drogowego (NHTSA) bada wypadki tesli, także pod kątem interakcji między systemami auta a człowiekiem.

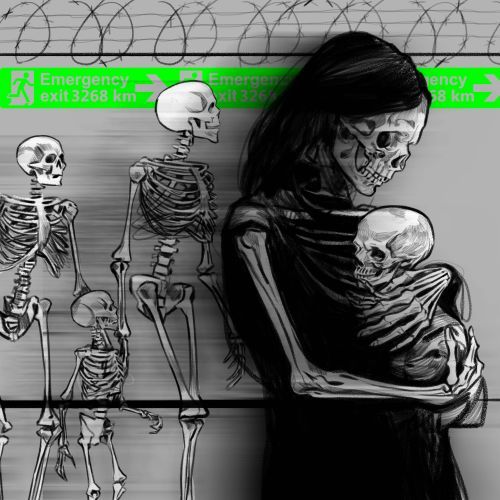

Według raportu National Endowment for Democracy (NED), analizującego trendy w inwigilacji przy użyciu sztucznej inteligencji, coraz więcej kamer działa w coraz większej liczbie miejsc przy niewielkim nadzorze w kwestii nadużywania nowych możliwości. Technologie monitoringu i rozpoznawania twarzy stosują np. departamenty policji w USA, władze Chin, Indii, Pakistanu oraz serbskiego Belgradu. Systemy służą nie tylko do walki z przestępczością, lecz także do monitorowania ruchu w internecie, protestów społecznych oraz uboższych, często zamieszkanych przez imigrantów dzielnic.