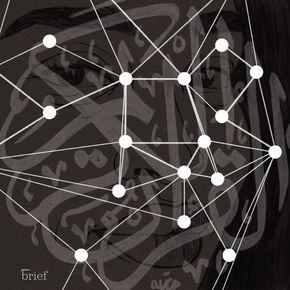

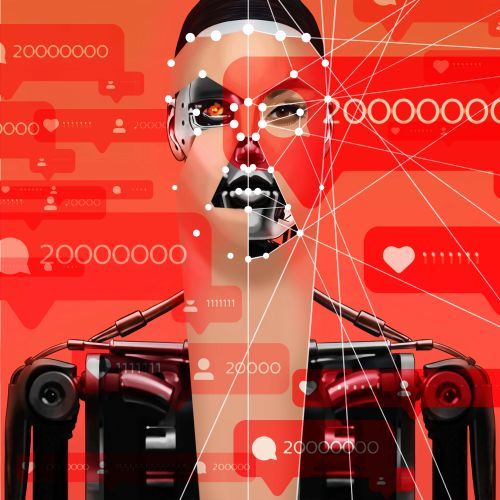

Technologia rozpoznawania twarzy i zagrożenia z nią związane

Technologia rozpoznawania twarzy używana do wyszukiwania osób w miejscach publicznych i stosowana przez policję w południowej Walii narusza prawo do prywatności – napisali we wniosku do sądu apelacyjnego w Wielkiej Brytanii prawnicy Liberty, organizacji broniącej praw obywatelskich. Argumentowali oni również, że system stosuje zasady dyskryminacji rasowej. Policja w południowej Walii zarejestrowała już dane biometryczne 500 tys. osób, z których przeważająca większość nie jest o nic podejrzana.

Amerykanin Robert Williams z Detroit jest pierwszą ujawnioną osobą, która została bezprawnie aresztowana z powodu błędnego rozpoznania twarzy przez oprogramowanie AI. Oprogramowanie zostało dostarczone przez firmę DataWorks Plus i było obsługiwane przez algorytmy japońskiej firmy technologicznej NEC oraz firmy Rank One Computing. Przepisy stosowane przez policję i dotyczące rozpoznawania twarzy podejrzanych są trudne do analizy i zależne od interpretacji funkcjonariuszy.

Systemy rozpoznawania twarzy są używane przez policję od ponad dwóch dekad. Według wyników najnowszych badań przeprowadzonych przez Massachusetts Institute of Technology i amerykański Narodowy Instytut Standaryzacji i Technologii (NIST) technologia rozpoznawania twarzy działa stosunkowo dobrze w przypadku białych mężczyzn, wyniki są jednak mniej dokładne dla innych profili demograficznych, częściowo z powodu zbyt małej różnorodności obrazów użytych do opracowania podstawowej bazy danych.

Naukowcy z Harrisburg University of Science and Technology twierdzą, że opracowane przez nich oprogramowanie „może przewidywać, czy ktoś jest przestępcą, na podstawie wyłącznie zdjęcia jego twarzy” i „ma na celu pomóc organom ścigania w zapobieganiu przestępczości”. Jednak 1700 badaczy innych uczelni jest przeciwko publikowaniu wyników tych badań, ponieważ oprogramowanie AI może kierować się uprzedzeniami rasowymi, płciowymi i ze względu na wiek.